Jethexa

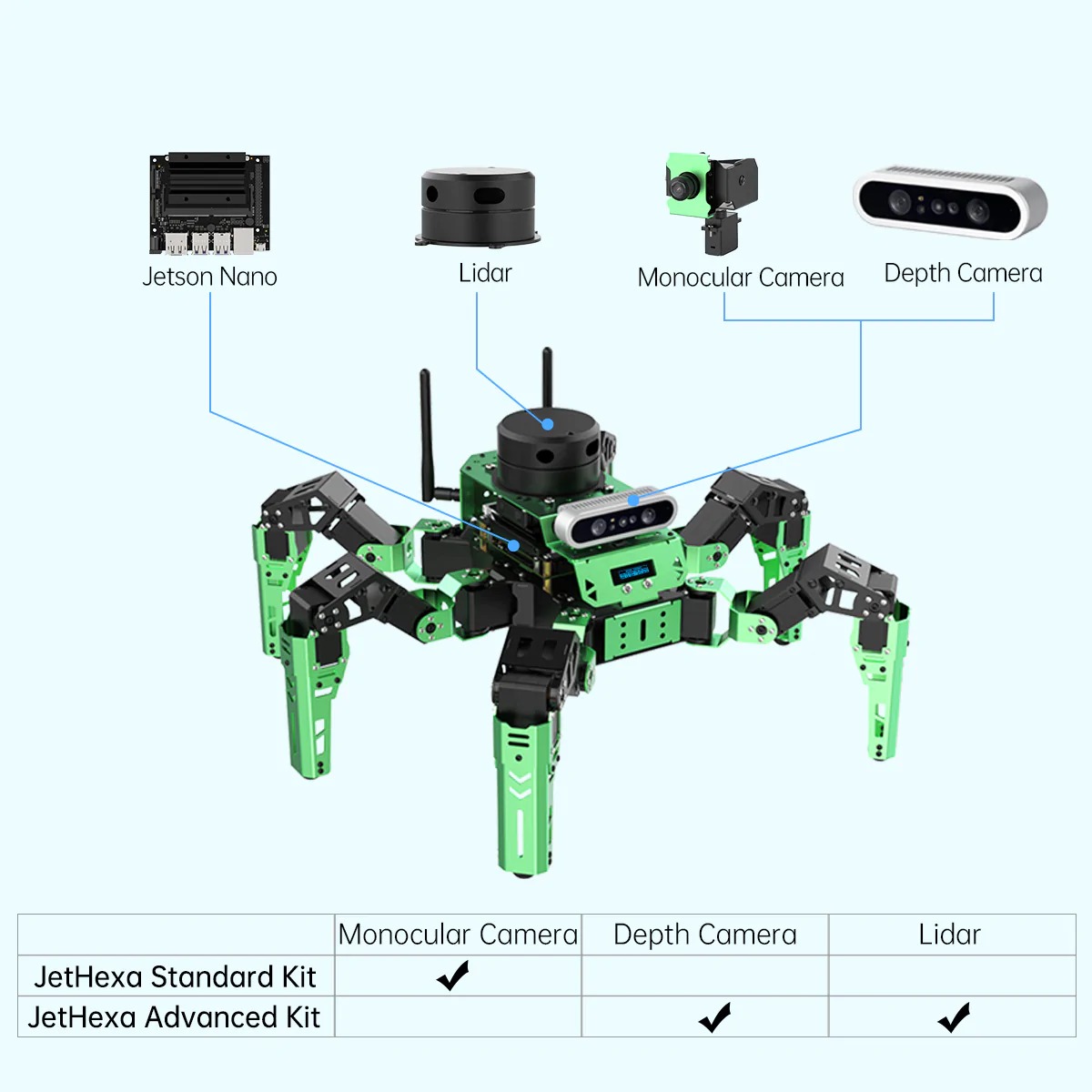

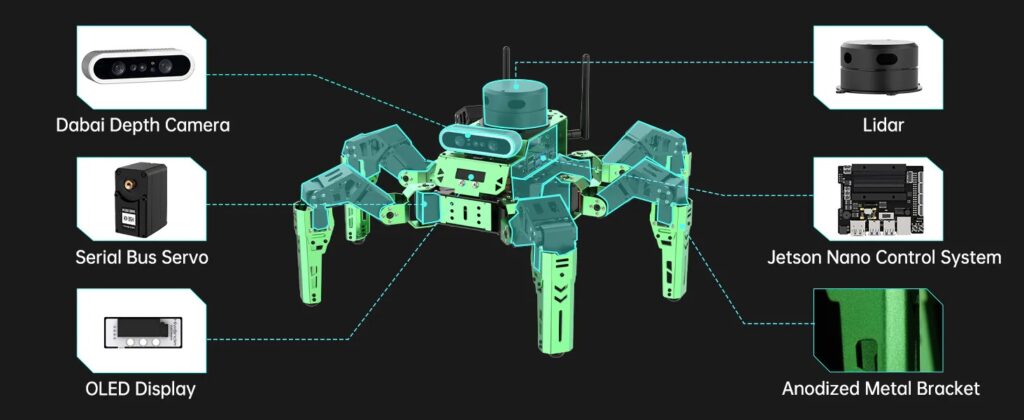

Hiwonder JetHexa ROS Hexapod Robot Kit alimentato da Jetson Nano con supporto per fotocamera di profondità Lidar Mappatura e navigazione SLAM

Con Lindar, tecnica di telerilevamento che permette di determinare la distanza di un oggetto o di una superficie utilizzando un impulso laser, e telecamera di profondità in grado di implementare il controllo del movimento del robot, la mappatura e la navigazione, il tracciamento e l’evitamento degli ostacoli

Descrizione prodotto

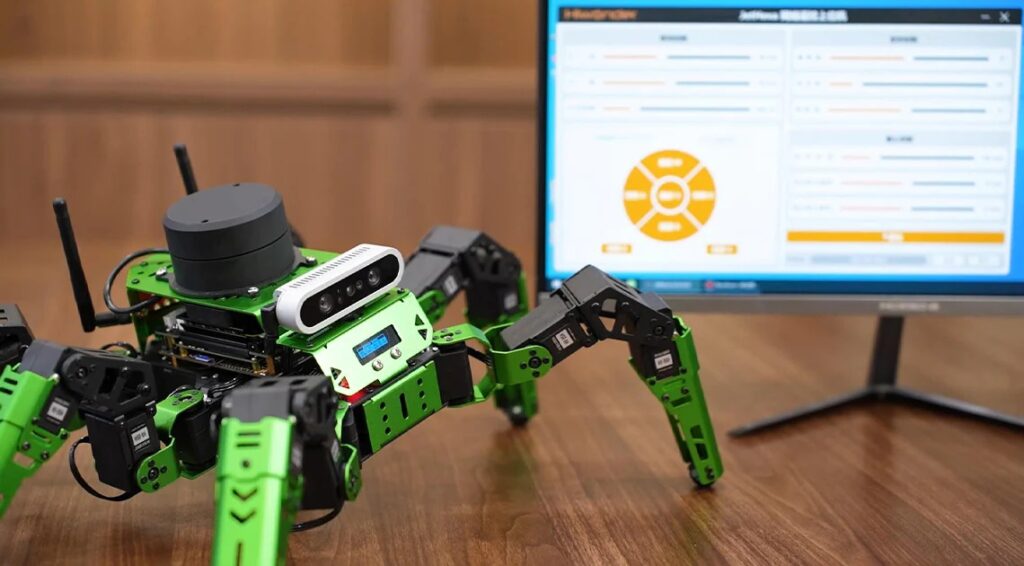

JetHexa è un robot hexapod open source basato su Robot Operating System (ROS). È dotato di hardware ad alte prestazioni, come NVIDIA Jetson Nano, servi bus seriali intelligenti, telecamera Lidar e HD/telecamera di profondità 3D, in grado di implementare il controllo del movimento del robot, la mappatura e la navigazione, il tracciamento e l’evitamento degli ostacoli, l’esplorazione personalizzata, la funzione umana riconoscimento, interazione somatosensoriale e altre funzioni. Adottato un nuovo algoritmo di cinematica inversa, che supporta le andature del treppiede e dell’ondulazione e con postura, altezza e velocità del corpo altamente configurabili, JetHexa offrirà all’utente la massima esperienza di utilizzo.

- Basato su NVIDIA Jetson Nano e basato su ROS

- Supporta telecamera di profondità e Lidar per la mappatura e la navigazione

- Algoritmo di cinematica inversa aggiornato

- Capace di deep learning e model training

- Apri il codice sorgente e fornisci ampi materiali e tutorial in PDF

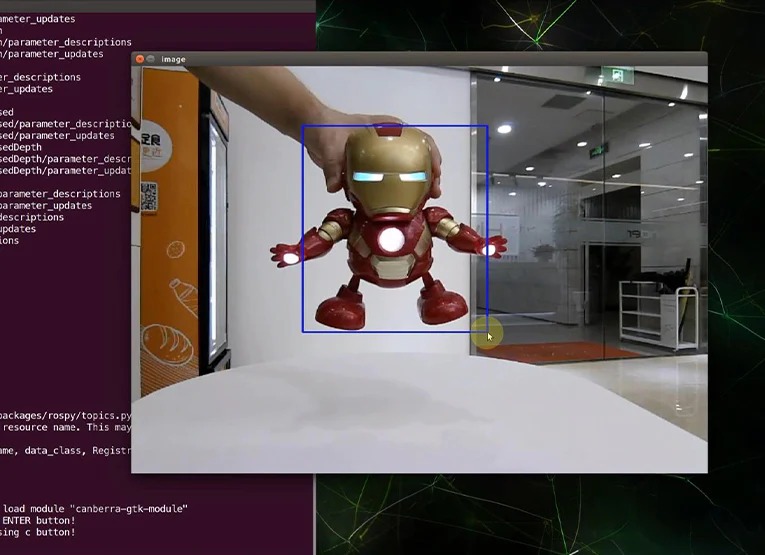

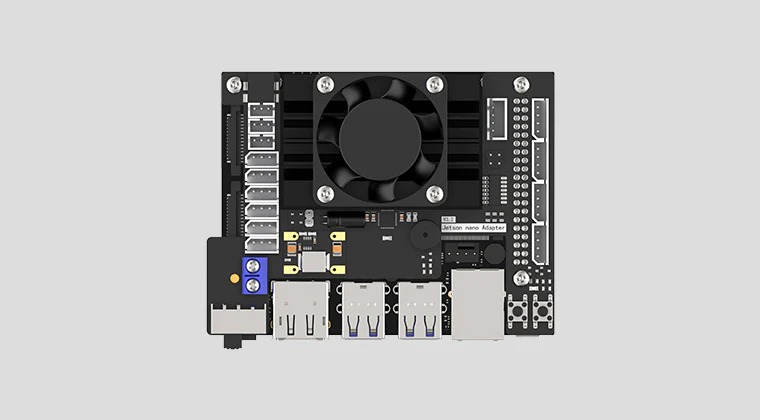

Sistema di controllo Nano Jetson

NVIDIA Jetson Nano è in grado di eseguire framework di deep learning tradizionali, come TensorFlow, PyTorch, Caffe/Caffe2, Keras, MXNet, e fornisce una potente potenza di calcolo per progetti di intelligenza artificiale di grandi dimensioni. Basato su Jetson Nano, JetHexa può ottenere riconoscimento di immagini, rilevamento e posizionamento di oggetti, stima della posa, segmentazione semantica, analisi intelligente e altre funzioni onnipotenti.

La fotocamera monoculare può ruotare su, giù, destra e sinistra, oltre a realizzare il tracciamento del colore, la guida autonoma e così via.

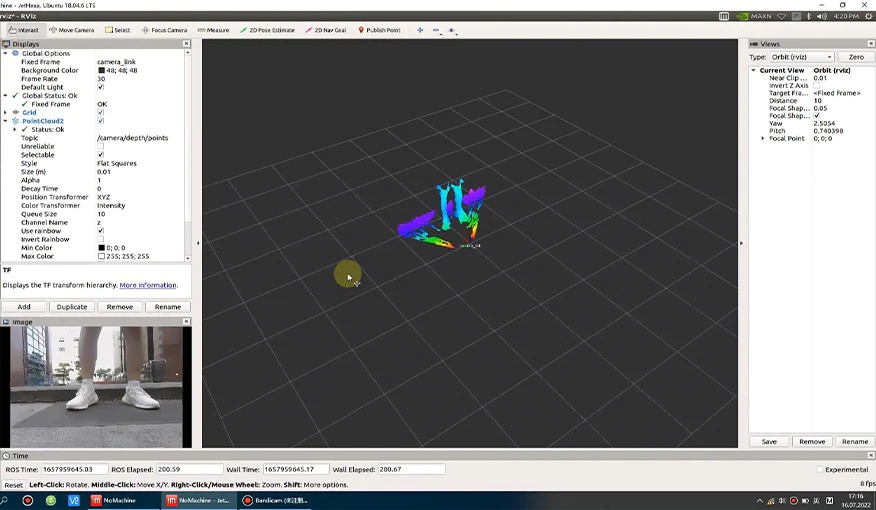

La telecamera di profondità può elaborare i dati della mappa di profondità e realizzare la navigazione della mappatura della visione 3D.

Punti salienti del ROS

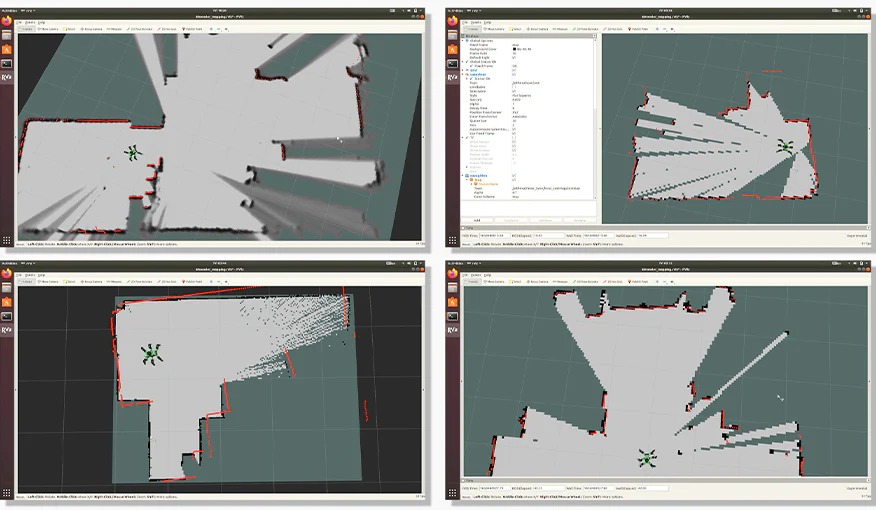

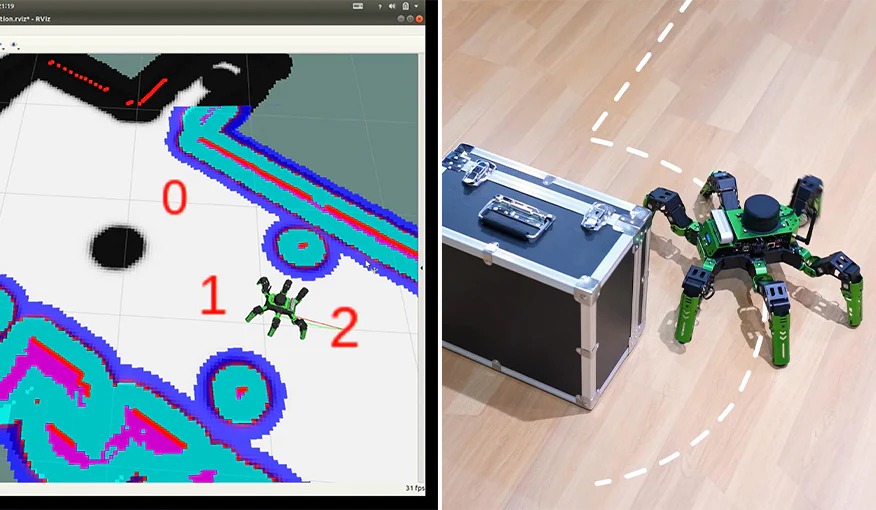

Mappatura 2D Lidar, navigazione ed evitamento degli ostacoli

JetHexa è caricato con EAI G4 Lidar ad alte prestazioni che supporta la mappatura con diversi algoritmi tra cui Cartographer, Hector, Karto e Gmapping, pianificazione del percorso, navigazione a punto fisso e prevenzione degli ostacoli nella navigazione.

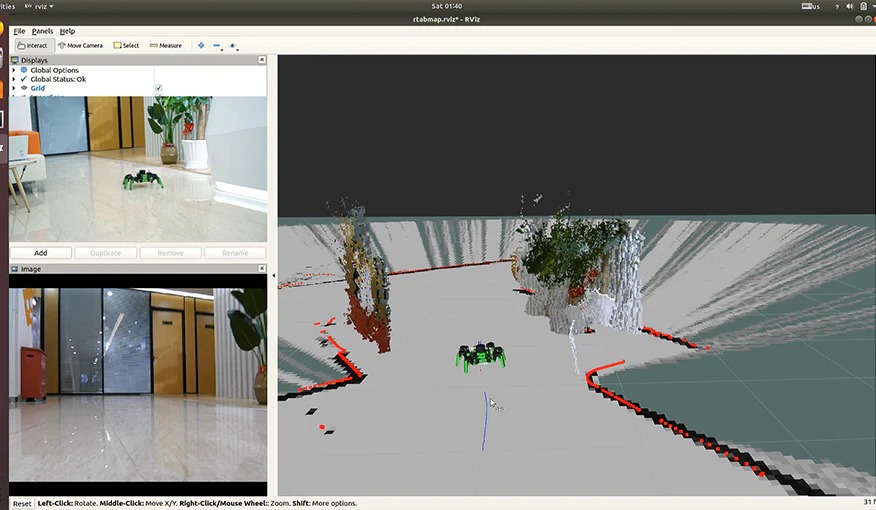

Mappatura e navigazione della visione 3D RTAB-VSLAM

Supportando la mappatura dei colori 3D in due modi, pura visione RTAB e fusione di visione e Lidar, JetHexa è in grado di navigare ed evitare ostacoli nella mappa 3D ed eseguire il trasferimento globale.

Navigazione multipunto ed evitamento degli ostacoli

Lidar può rilevare l’ambiente circostante in tempo reale e lasciare che JetHexa eviti gli ostacoli durante la navigazione muti-point.

Dati immagine di profondità, immagine nuvola di punti

Attraverso l’API corrispondente, JetHexa può ottenere l’immagine di profondità, l’immagine a colori e l’immagine della nuvola di punti della telecamera.

Basato sull'algoritmo di filtraggio KCF, il robot può tracciare il target selezionato.

Scansionando l'oggetto in movimento anteriore, Lidar rende il robot in grado di tracciare il bersaglio.

Un gruppo di JetHexa può essere controllato da un solo handle wireless per eseguire azioni in modo uniforme e simultaneo.

Il robot ha la capacità di riconoscere la linea nel colore designato dall'utente e di aggirare la linea.

L'utente può personalizzare il percorso e ordinare al robot di aggirarsi lungo il percorso progettato.

Built-in IMU sensor can detect the body posture in real time.

Con l'aiuto della telecamera di profondità, può rilevare l'ostacolo davanti e passare attraverso l'ostacolo.

Lidar spiega il ruolo nel proteggere l'ambiente circostante e far suonare l'allarme quando rileva un intruso.

Un lotto di robot può essere controllato per pattugliare in diverse formazioni.

JetHexat è un esperto nel riconoscimento e nel posizionamento di alcuni tag AR contemporaneamente.

Abile nel riconoscimento e nel tracciamento dei colori, il robot può essere impostato per eseguire diverse azioni in base ai colori.

Quando Lidar scansiona il canyon davanti a sé, il robot regolerà la sua postura e direzione per attraversarlo.

Algoritmo di cinematica inversa aggiornato

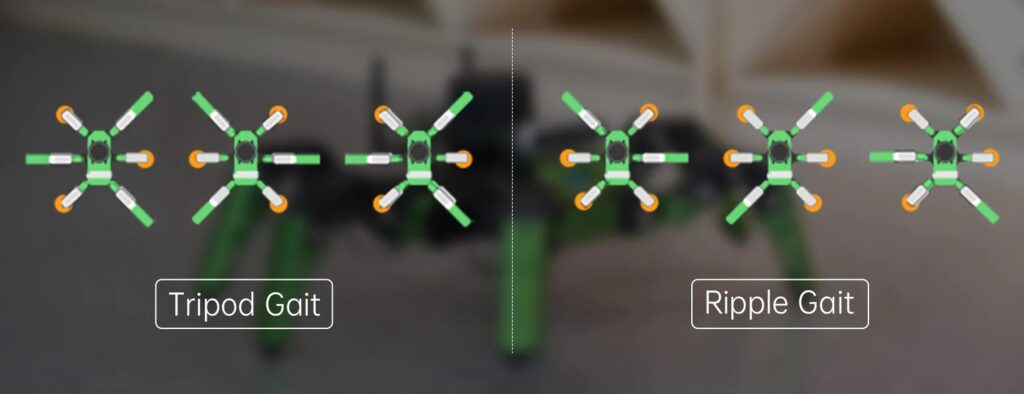

Cambio di andatura con un clic

JetHexa supporta il passaggio a piacimento tra l’andatura del treppiede e l’andatura ondulata.

Attraverso l'algoritmo della cinematica inversa, JetHexa può mantenersi stabile durante la mappatura SLAM e il moonwalk a velocità costante.

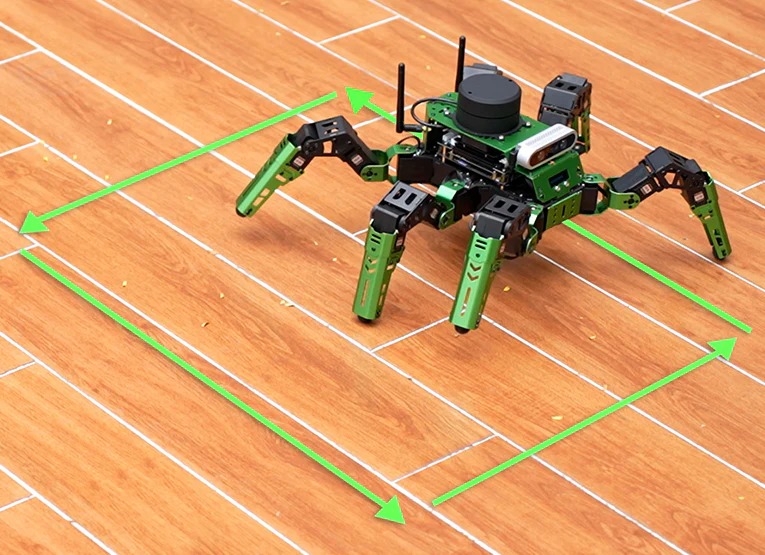

JetHexa può girare e cambiare corsia in movimento e supportare la regolazione continua della velocità lineare, della velocità angolare, della posizione, dell'altezza e del passo.

Highly configurable body posture, center of gravity, pitch angle and roll angle enables the hexapod robot to overcome all type of complicated terrains.

Il sensore IMU integrato ha il compito di rilevare la postura del corpo in tempo reale in modo che il robot regoli le sue articolazioni per bilanciare il corpo.

Deep Learning e Model Training per la creatività AI

Adottando GoogLeNet, Yolo, mtcnn e altre reti neurali, JetHexa padroneggia il deep learning per addestrare i modelli. Attraverso il caricamento di vari modelli, è in grado di riconoscere rapidamente gli obiettivi in modo da implementare progetti di intelligenza artificiale complessi, tra cui raccolta differenziata, identificazione delle maschere, riconoscimento delle emozioni, ecc.

Riconoscere velocemente le diverse carte rifiuti e posizionarle nell'area corrispondente in base alla categoria.

Con una forte potenza di calcolo, la funzione AI di JetHexa può essere ampliata attraverso il deep learning.

JetHexa è in grado di riconoscere accuratamente i lineamenti del viso per cogliere ogni sfumatura di espressione.

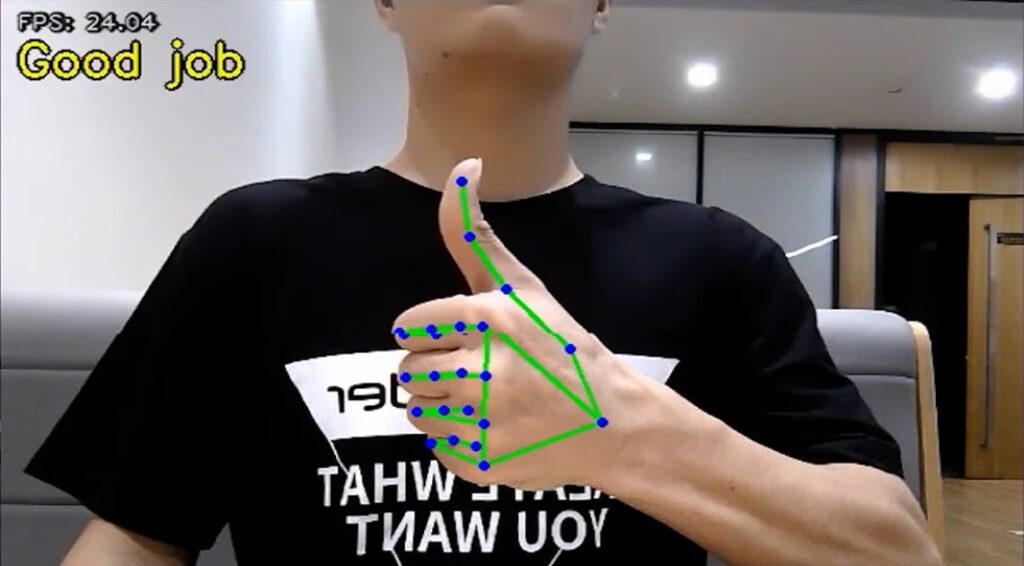

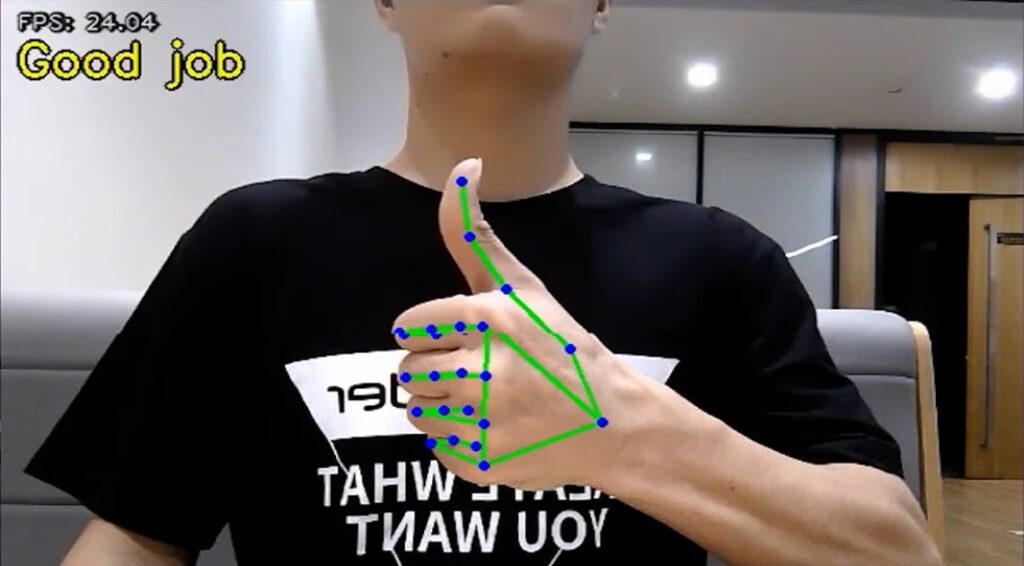

Sviluppo MediaPipe, interazione AI aggiornata

Basato sul framework MediaPipe, JetHexa può eseguire il rilevamento del corpo umano, il rilevamento della mano, il rilevamento della postura, il rilevamento generale, il rilevamento del viso, il rilevamento 3D e altro ancora.

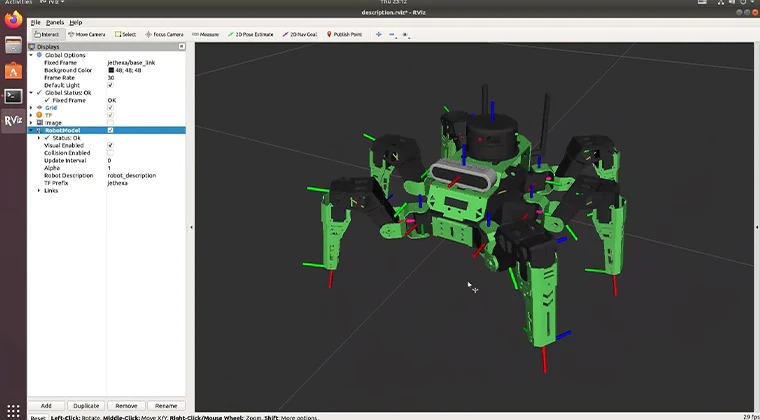

Sistema operativo del robot ROS

ROS è un meta sistema operativo open source per robot. Fornisce alcuni servizi di base, come l’astrazione dell’hardware, il controllo del dispositivo di basso livello, l’implementazione di funzionalità comunemente utilizzate, il passaggio di messaggi tra i processi e la gestione dei pacchetti. Inoltre offre gli strumenti e le funzioni di libreria necessarie per ottenere, compilare, scrivere ed eseguire codice su più computer. Mira a fornire supporto per il riutilizzo del codice per la ricerca e lo sviluppo della robotica.

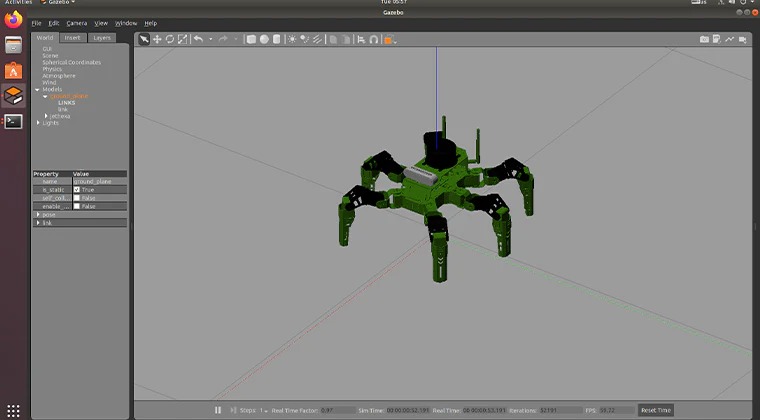

Simulazione gazebo

Verificare l'algoritmo della cinematica in simulazione in modo da evitare il danneggiamento del robot dovuto all'errore dell'algoritmo.

Vengono forniti dati visivi per l'osservazione dell'estremità del robot e della traiettoria del baricentro per ottimizzare l'algoritmo.

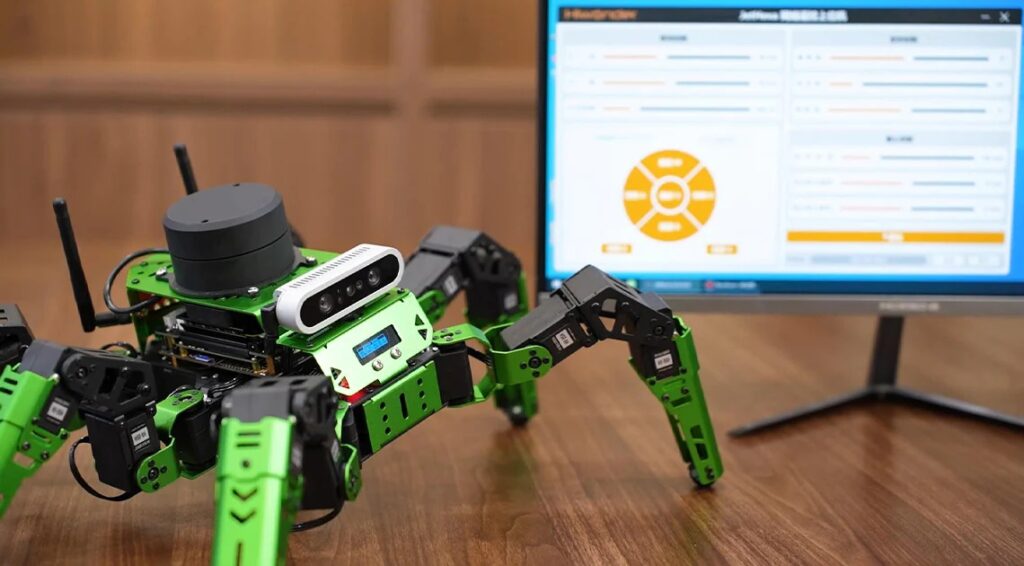

Vari metodi di controllo

Struttura prodotto

Presenta una coppia di 35 kg, alta precisione, feedback dei dati, cablaggio semplice, tensione di alimentazione 12V e potenza elevata.

Visualizza le proprietà del controller e la tensione della batteria in tempo reale e supporta l'impostazione personalizzata.

La staffa metallica del robot è finemente anodizzata per un aspetto delicato e una lunga durata.

La fotocamera Sony monoculare grandangolare da 8 megapixel o la fotocamera binoculare Orbbec 3D con profondità di luce strutturata possono ottenere il riconoscimento AI ad alta precisione multi-scenario. E la telecamera di profondità può realizzare la mappatura e la navigazione 3D.

Il sensore IMU di bordo è in grado di rilevare la postura del corpo in tempo reale. Sulla scheda di espansione sono presenti servoport PWM a 2 canali, 2 tasti, 1 LED, 2 interfacce di espansione GPIO e 2 interfacce IIC.

Scarica le risorse e segui le video lezioni

Specifiche tecniche

| Peso del prodotto | 2,5 kg |

|---|---|

| Materiale | staffa in lega di alluminio duro interamente in metallo (anodizzato) |

| Pan-tilt della fotocamera monoculare | 2 DOF |

| Batteria | batteria Lipo 11.1 3500 mAh 5C |

| Durata della batteria | 60 min |

| Robot DOF | 18DOF |

| Hardware | Controller ROS e ROS |

| Sistema operativo | Ubuntu 18.04 LTS + ROS Melodic |

| Software | Software per PC + APP iOS/Android |

| Metodo di comunicazione | USB / Wi-Fi / Ethernet |

| Linguaggio di programmazione | Python/C/C++/JavaScript |

| Memoria | Scheda TF da 32 GB |

| Servo | Servo bus seriale intelligente HX-35H |

| Metodo di controllo | Controllo computer / smartphone / controllo manuale con joystick |

| Dimensioni del pacchetto | 387(L) x 356(P) x 210(H) mm |

| Peso (con imballo) | 3,6 kg |

| Tipo batteria | batteria Lipo 11.1V 3500mAh 5C |

| Capacità batteria | 3500 mAh |

| Corrente di scarica nominale batteria | 5C |

| Spina batteria | Spina SM + DC femmina |

| Voltaggio batteria | 11,1 V |

| Dimensioni batteria | 72(L) x 55(P) x 19(H) mm |

| Peso batteria | 159gr |

| Caricabatterie | 12,6V |

| contenuto della confezione standard kit | Jethexa (fotocamera monoculare inclusa) |

| contenuto della confezione advanced kit | Jethexa (fotocamera di profondità e lidar inclusi) |